こんにちは、AI FREAKです。

本記事では『Stable Video』の使い方をご紹介します。

しかし、Web版の『Stable Video』がリリースされたことで、誰でも簡単に操作することができるようになりました。

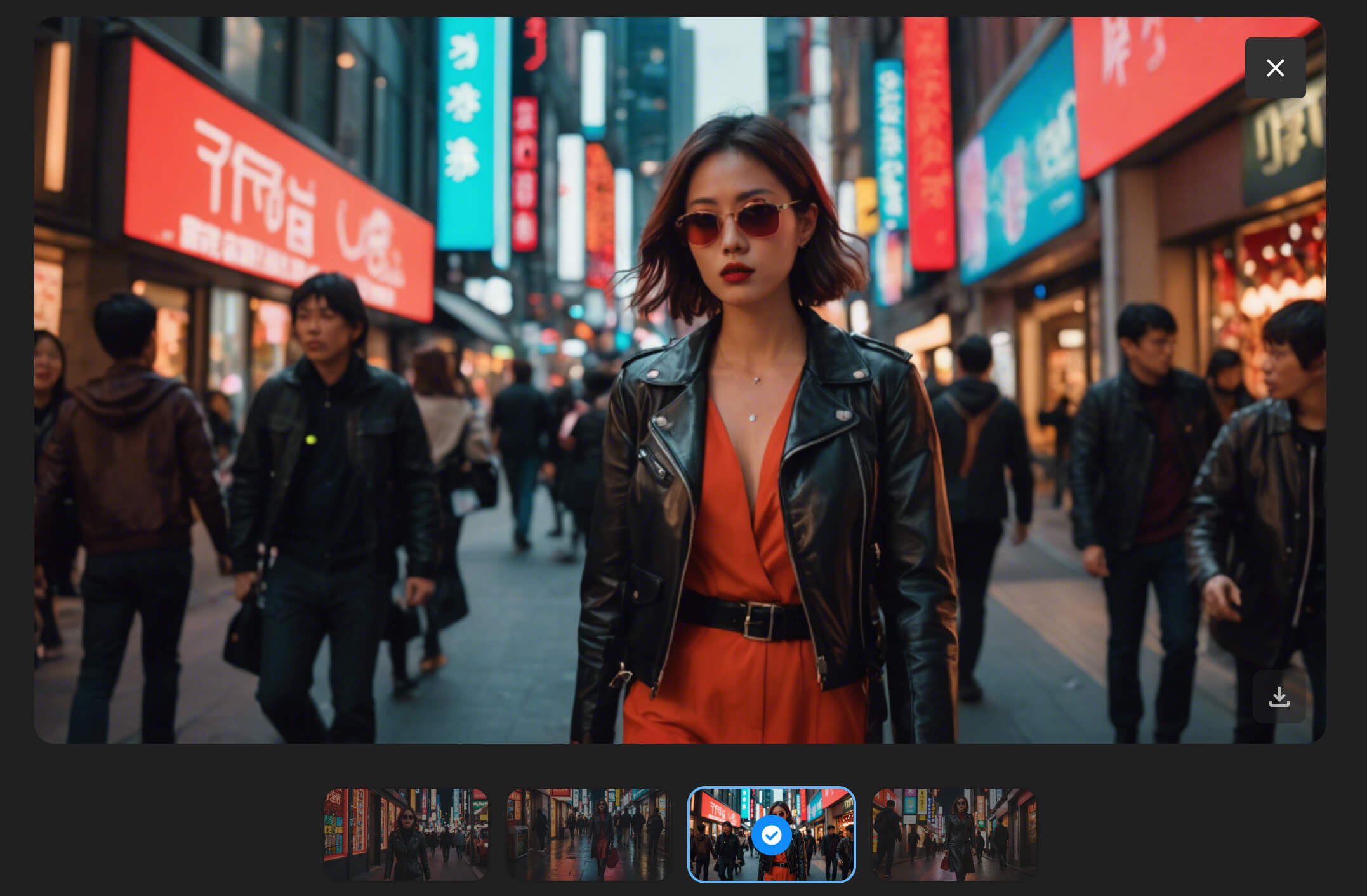

Stable Videoを使うと、このような動画を生成することができます。

遂に【Stable Video Diffusion】が誰でも簡単にWebから使えるようになりました。(β版)

現時点では、無料で150クレジット付与されるので、誰でも10個程度動画を作る事ができます。… pic.twitter.com/EtypQKorTm

— AI FREAK@AI最新情報をお届け (@AiFreak_tool) February 24, 2024

Midjourneyで生成した画像を、Stable Videoで動かし、音に合わせて編集をしています。

今なら無料でお試し可能なので、ぜひ試してみてください。

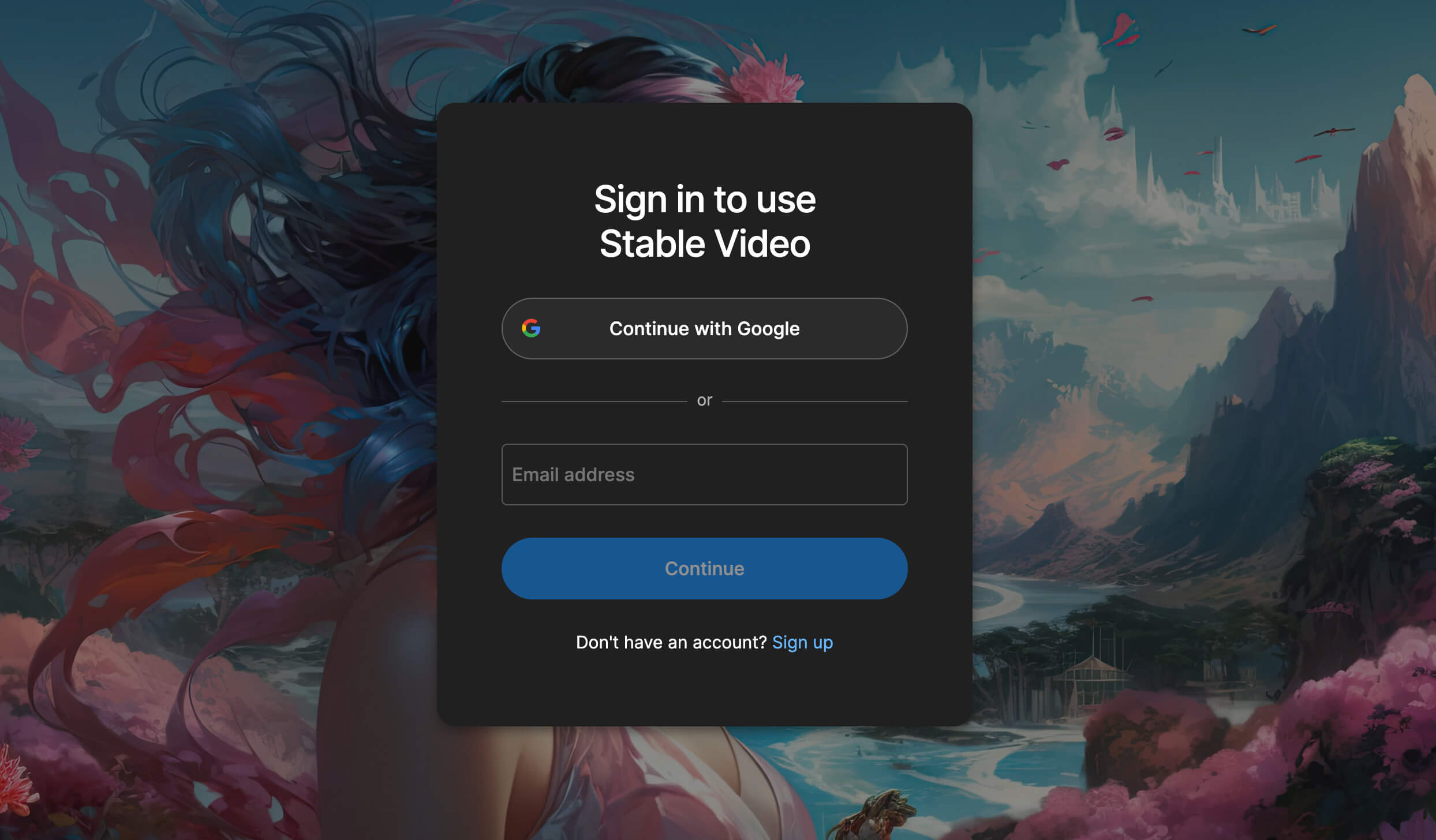

会員登録・ログイン方法

まずはこちらのリンクから、Stable Videoの公式ページにアクセスします。

会員登録ページに遷移するので、googleアカウントかメールアドレスにて、登録を進めましょう。

参考までに、私はgoogleアカウントでログインしています。

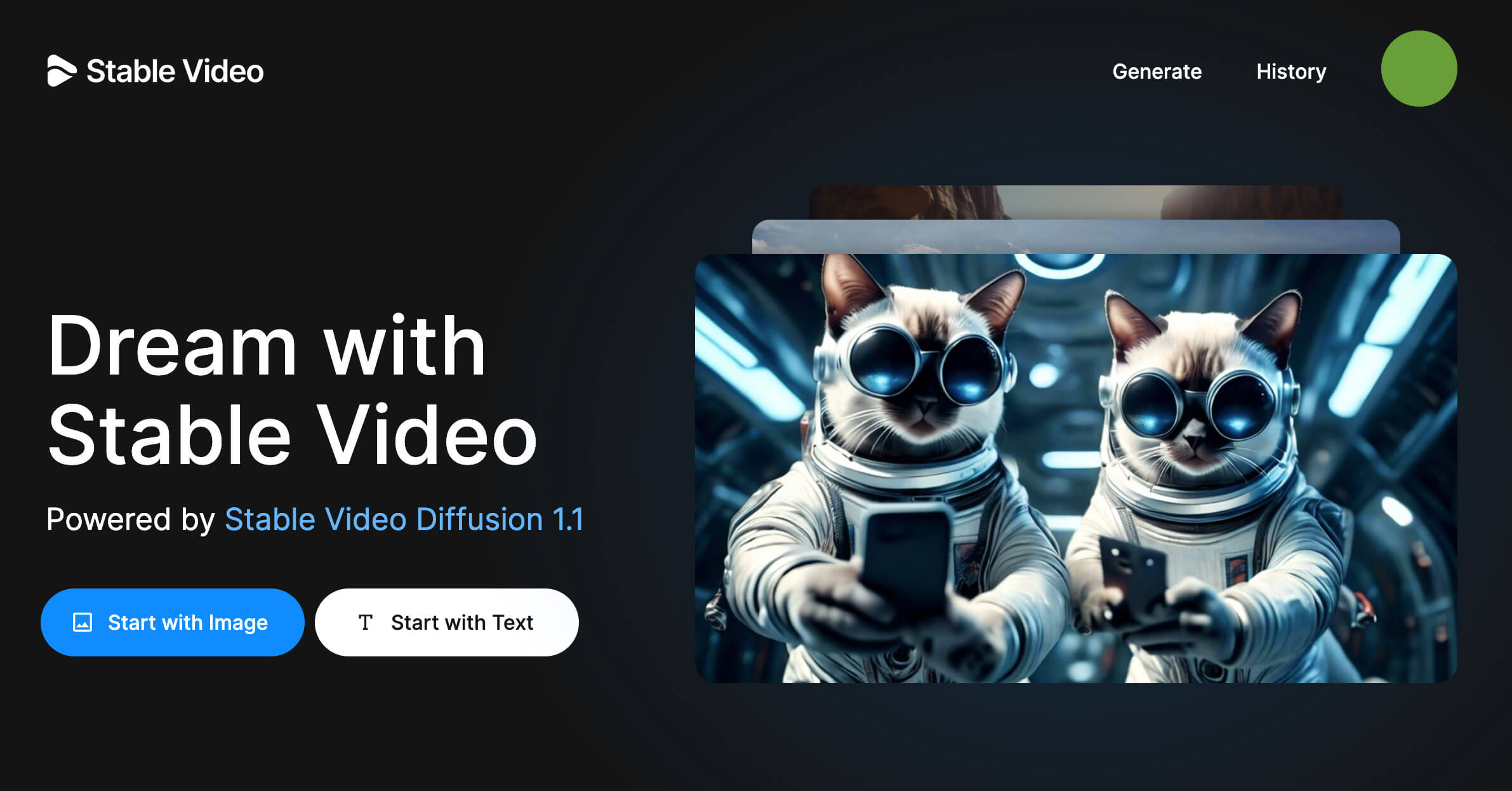

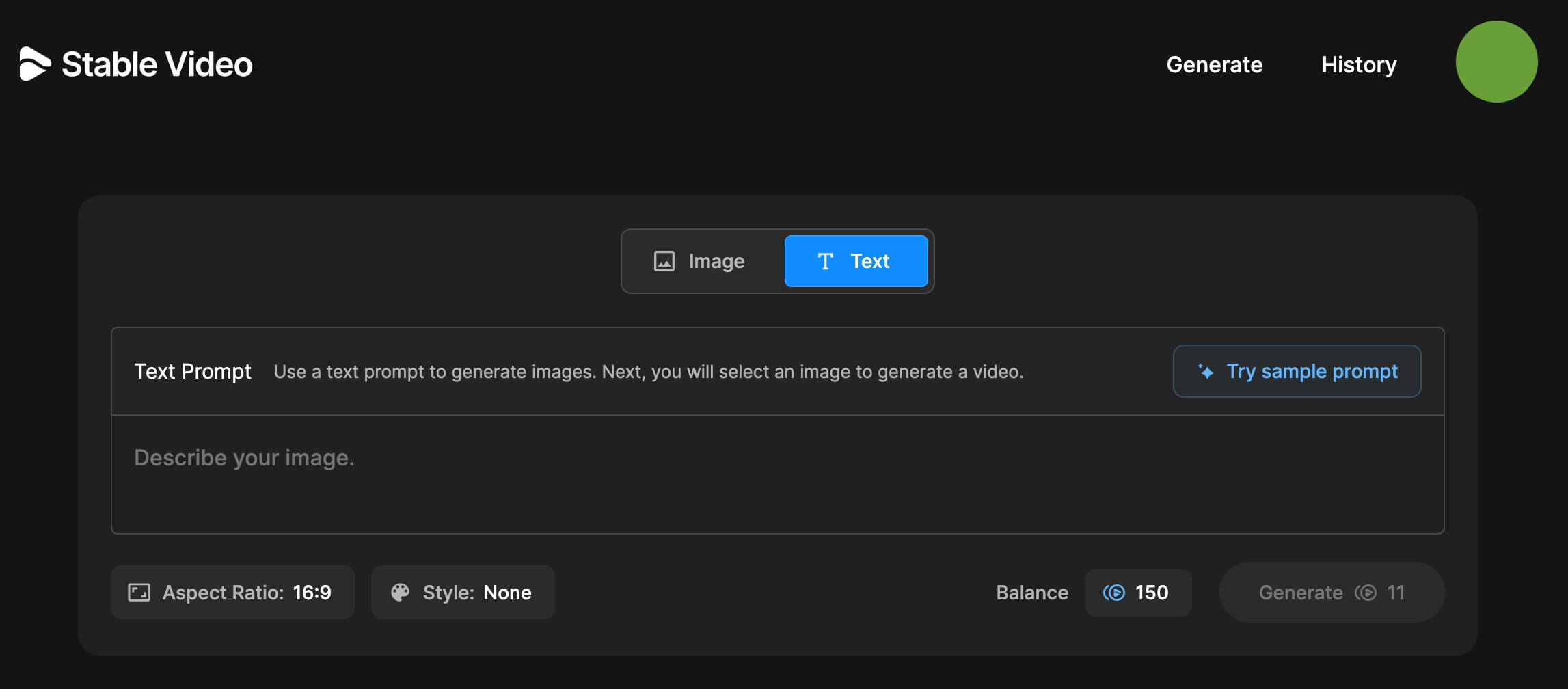

ログインが完了すると、このような画面が表示されます。

トップページには、Stable Video Diffusion 1.1の提供である旨が記載されています。

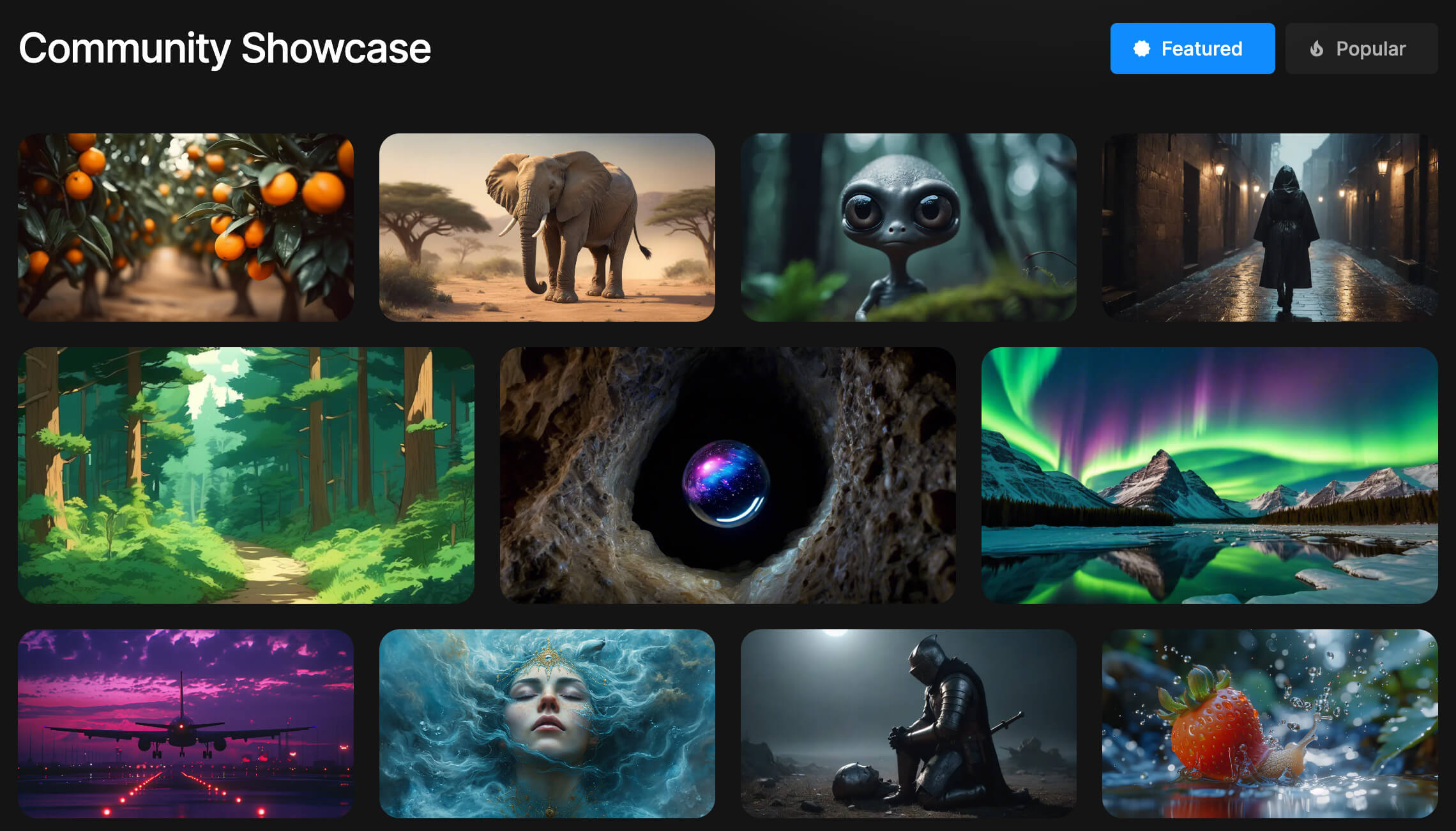

少し下の方にいくと、生成された動画のサンプルを見ることができます。

最近話題になった、OpenAIのsora程の衝撃こそないものの、しっかり静止画がスムーズに動いていることがわかります。

それでは、早速動画を作ってみましょう。

テキストプロンプトから動画を作る

作り方は非常に簡単なのですが、大きく分けて

- 『画像』を動画にする方法

- 『テキストプロンプトを打ち込んで』動画にする方法

に分かれます。

まずは、テキストプロンプトから動画にする方法を見ていきましょう。

Start with textというボタンをクリックすると、このような画面が表示されます。

こちらの空欄部分に、動画化したいテキストプロンプトを入力しましょう。

せっかくなので、今回は話題になっているOpenAIのsoraのサンプルプロンプトを打ち込んで比較してみましょう。

soraの公式ページに飛ぶと、動画のプロンプトを確認できます。

ニュースでも散々流れていたので、こちらの女性が歩いているシーンは見たことがある人も多いのではないでしょうか。

こちらの動画の下部に、プロンプトの詳細があるのでコピーします。

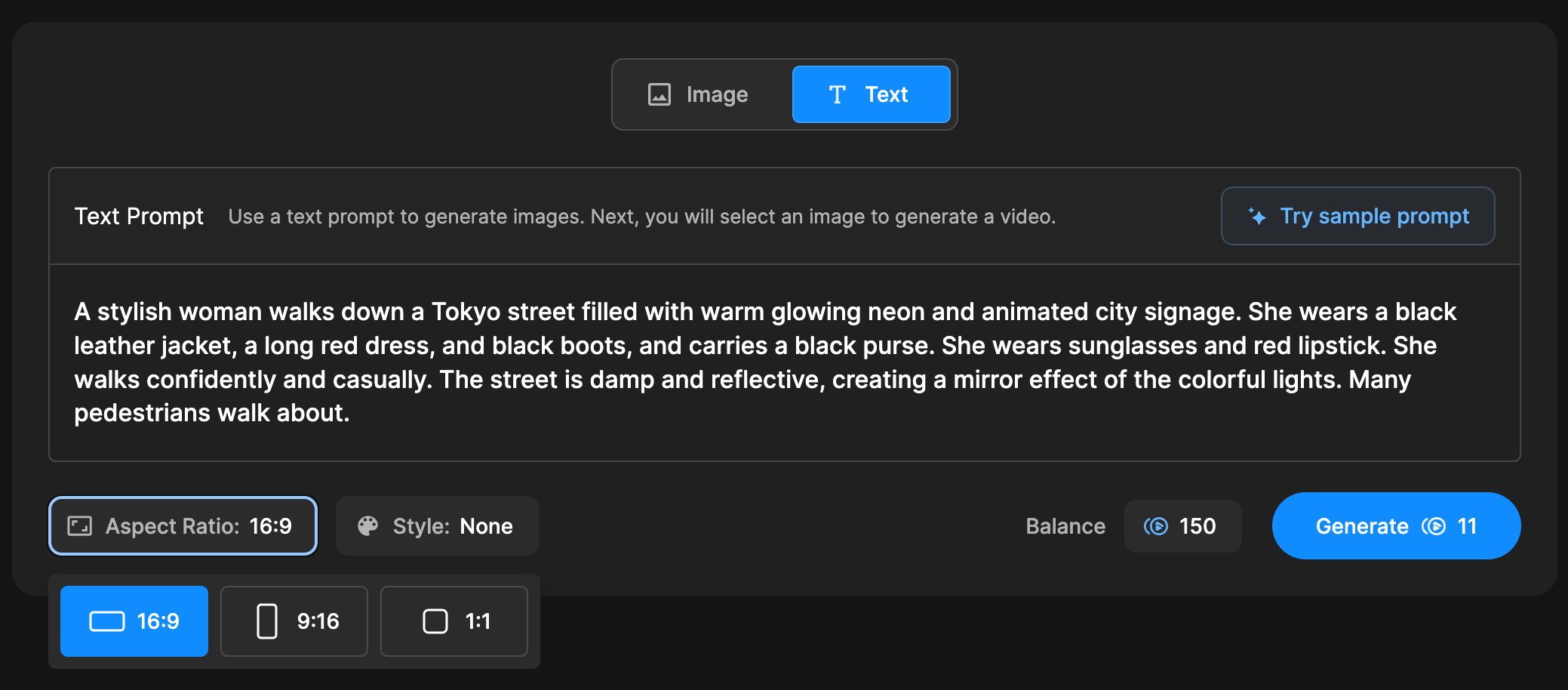

A stylish woman walks down a Tokyo street filled with warm glowing neon and animated city signage. She wears a black leather jacket, a long red dress, and black boots, and carries a black purse. She wears sunglasses and red lipstick. She walks confidently and casually. The street is damp and reflective, creating a mirror effect of the colorful lights. Many pedestrians walk about

そしてこちらの空欄にペーストします。

縦横比や、画像のスタイルを選択することができます。現時点では縦横比は三つしか選択肢しかないようです。

今回は横長の動画(16:9)にしたいと思います。

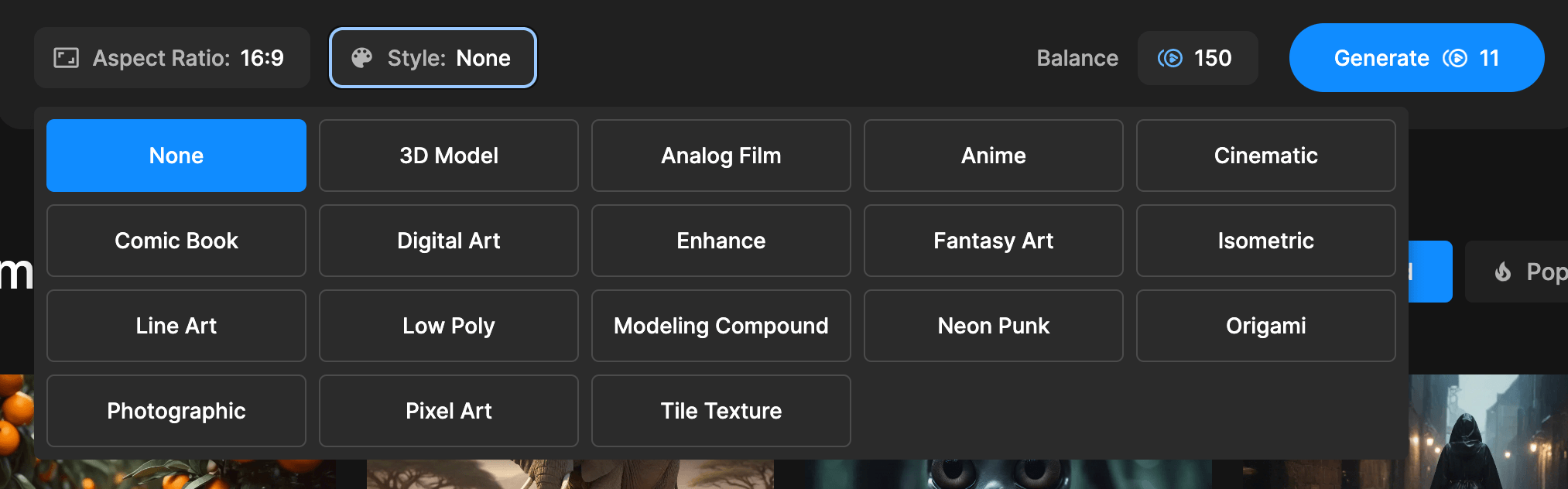

縦横比を選択したら、スタイルを選びましょう。

スタイルは選択肢がとても豊富ですが、今回はリアルな描写にしたいのでCinematic(シネマティック)を選択します。

項目を選択し終えたら、Generateをクリックしましょう。

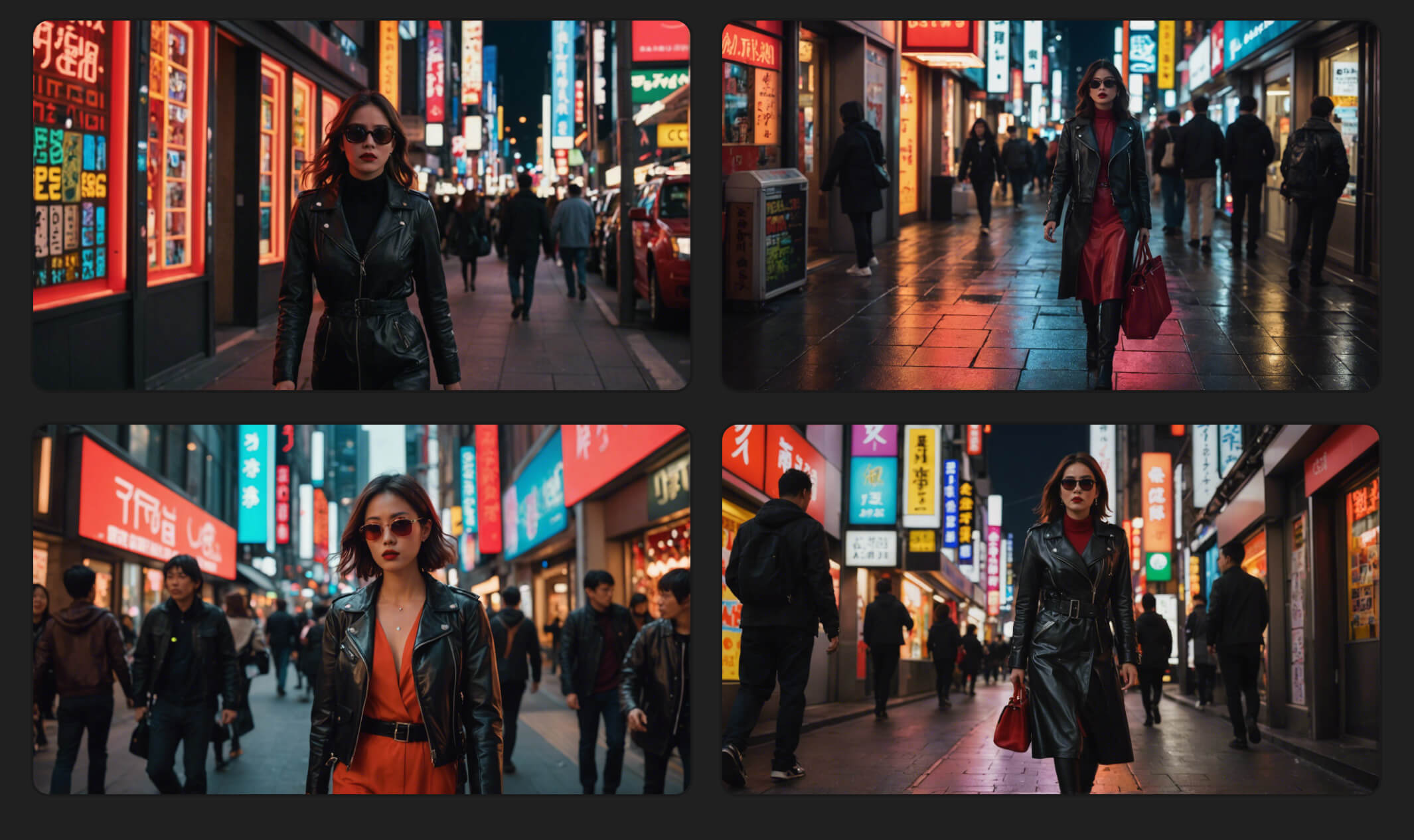

すると、すぐに4枚の画像が生成されました。

この中から、動画化したいイメージを一つ選択するということです。

今回はこちらの画像を選択しましょう。

画像を選択したら、下部にスクロールします。

すると、動画の詳細設定ができます。

今回はひとまず、何も設定を変えずに生成してみましょう。

動画の生成には5分ほどかかりました。

出来上がった動画がこちらです。

それなりに良い感じに女性が歩いてくれています。

Soraと比較してしまうと、劣ってしまうことは明らかではありますが、soraが使えない現状であればなかなかクオリティではないでしょうか。

それでは、次は画像から動画生成する機能を見ていきましょう。

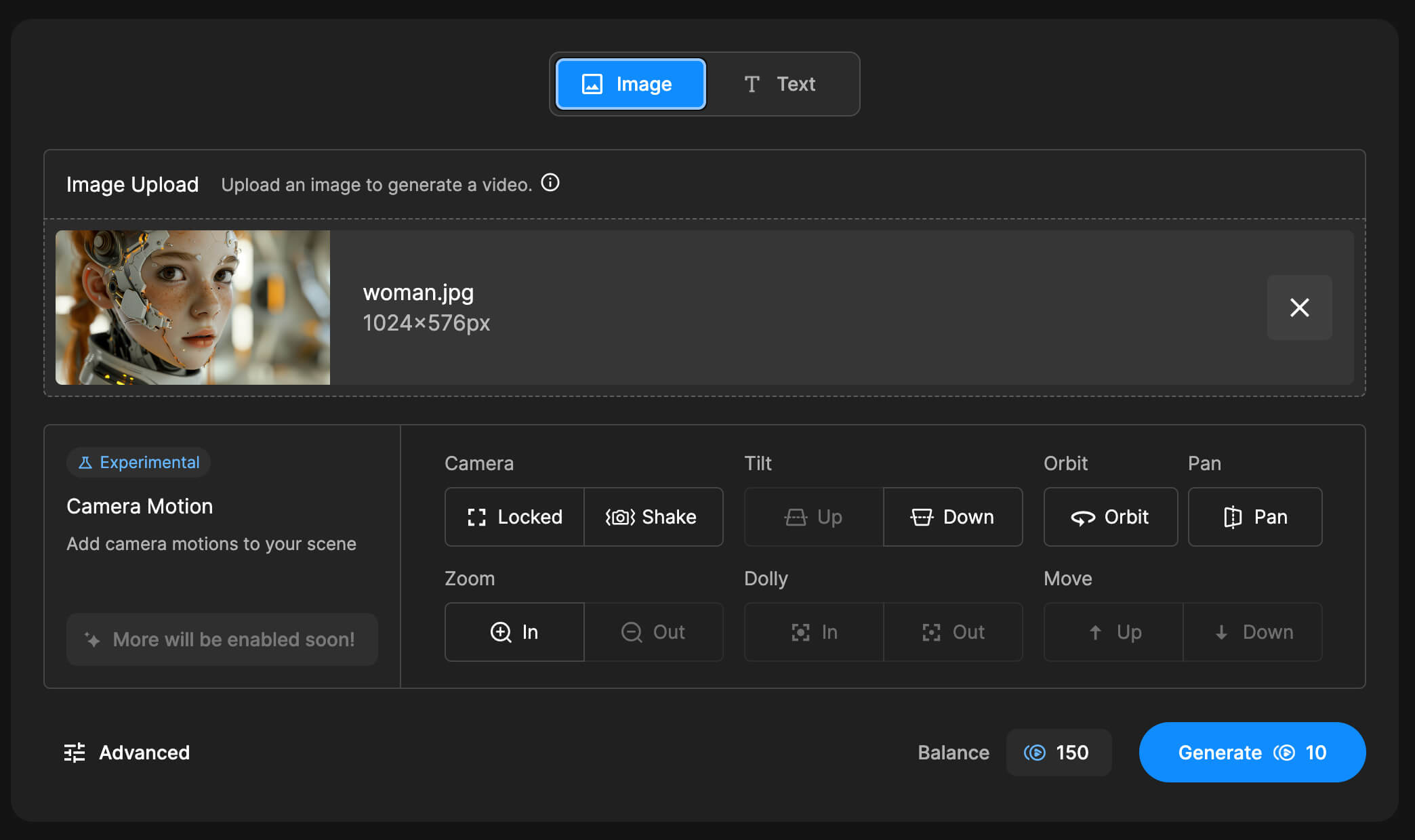

画像から動画生成する方法

基本的な流れはほとんど同じです。

こちらの空欄にテキストプロンプトを入れる変わりに、動画化したい画像をドロップします。

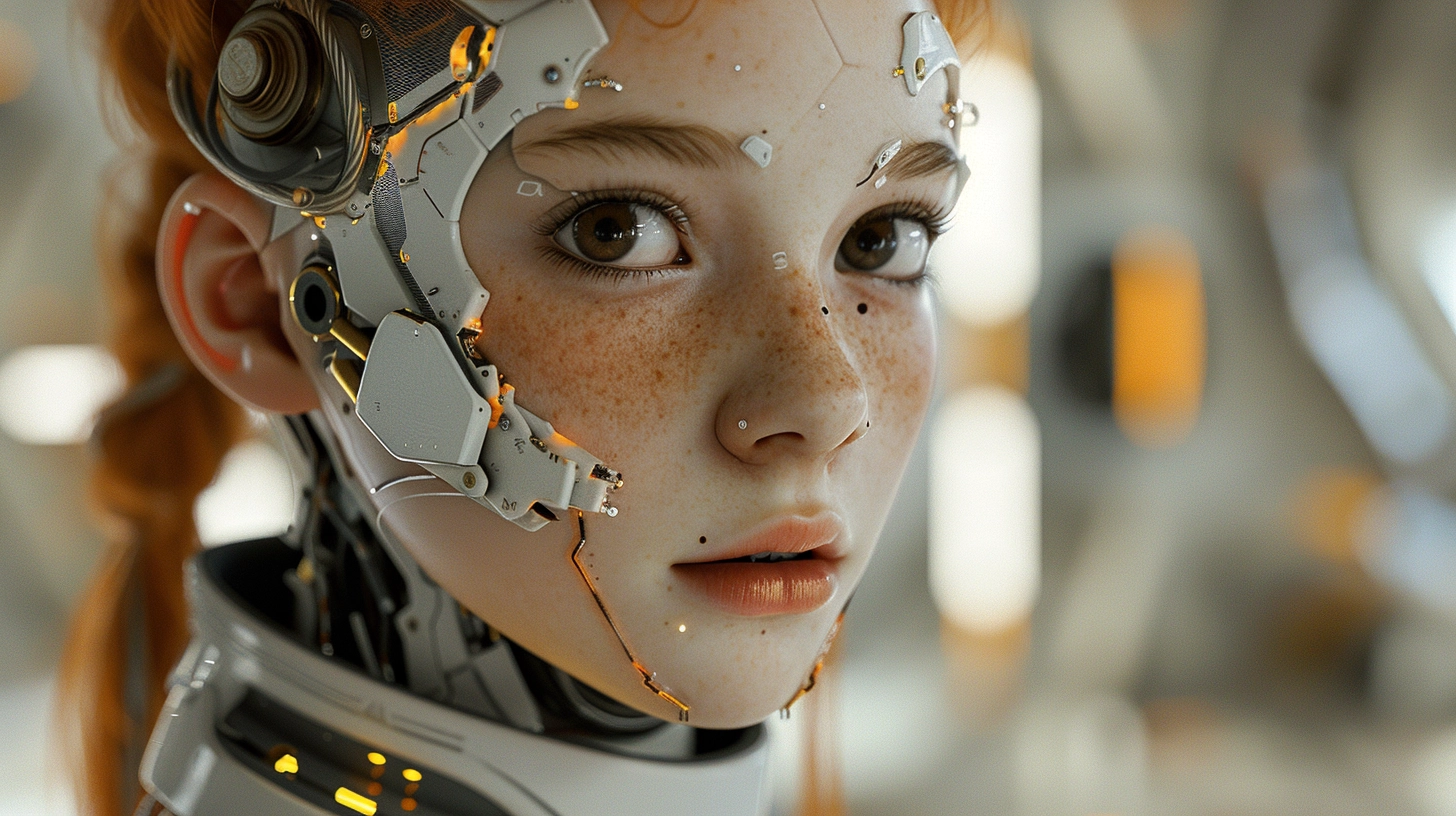

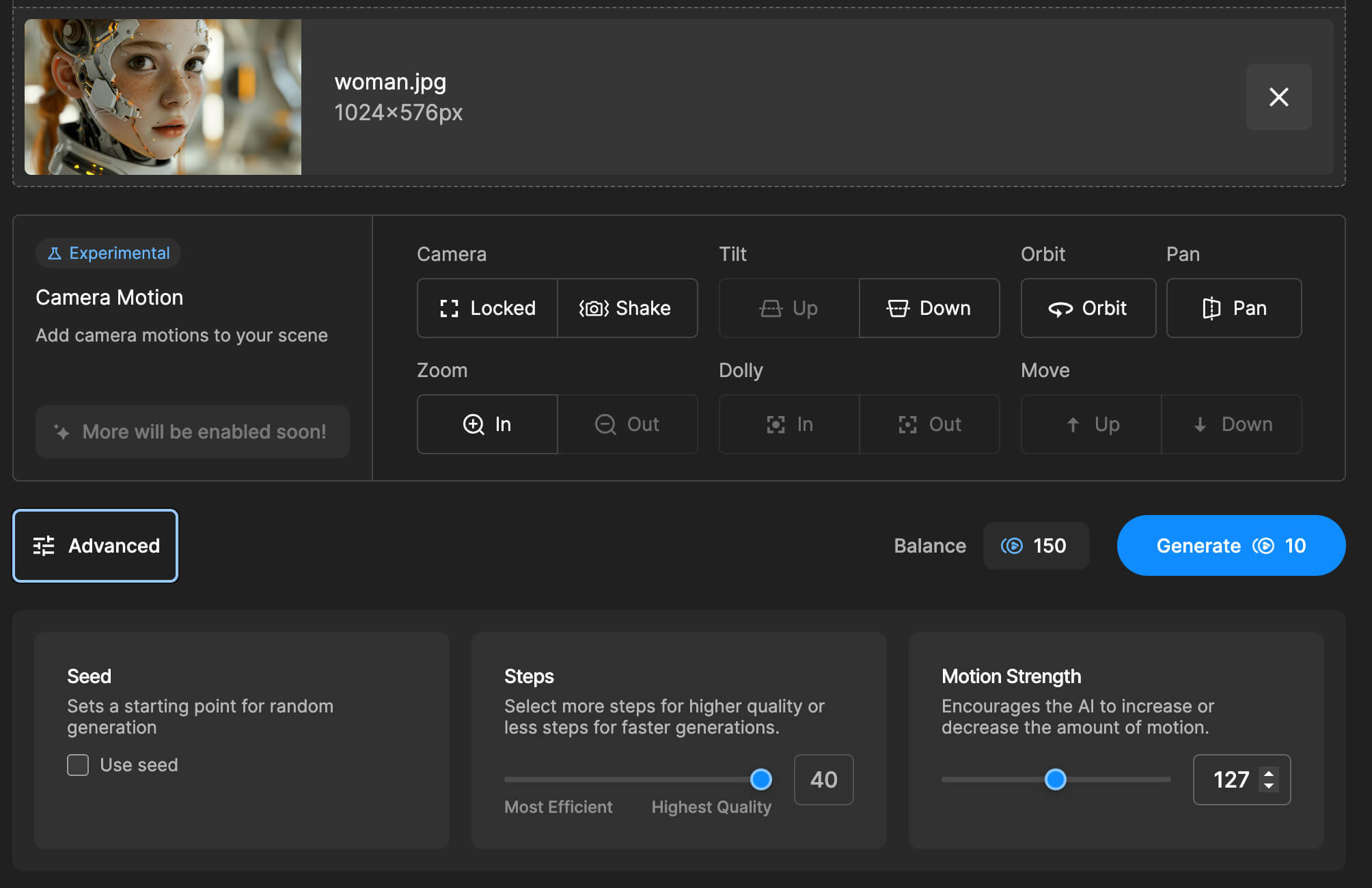

今回は、こちらの未来的な女性を空欄部分にドロップしました。

Midjourneyにて生成した女性ですが、うまく動くか試してみましょう。

こちらも先ほどと同じように、詳細設定も色々と選択できるのですが、ひとまずデフォルトのままで生成してみます。

5分ほど待つと、このような動画が出来上がりました。

元々の画質を活かしたまま、綺麗な動きをつけてくれています。

テキストから生成する画像よりは、動きは小さいですが、破綻は少ない仕上がりとなりました。

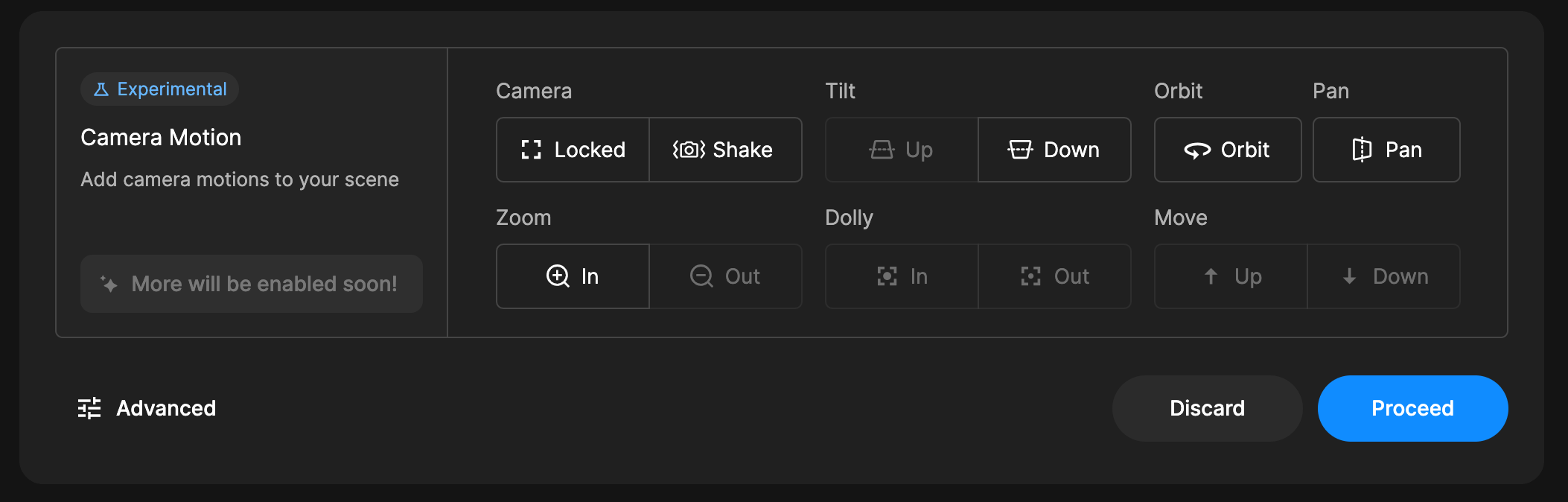

詳細設定について

上記2つのパターンは、いずれのデフォルトの設定で動画を生成しました。

現状は、添付画像のようにCamera/Tilt/Zoom等の項目設定が可能です。

例えばCameraのShakeを選択すると、このような動画が生成されました。

自然な手ぶれ(?)のような揺れを再現してくれています。

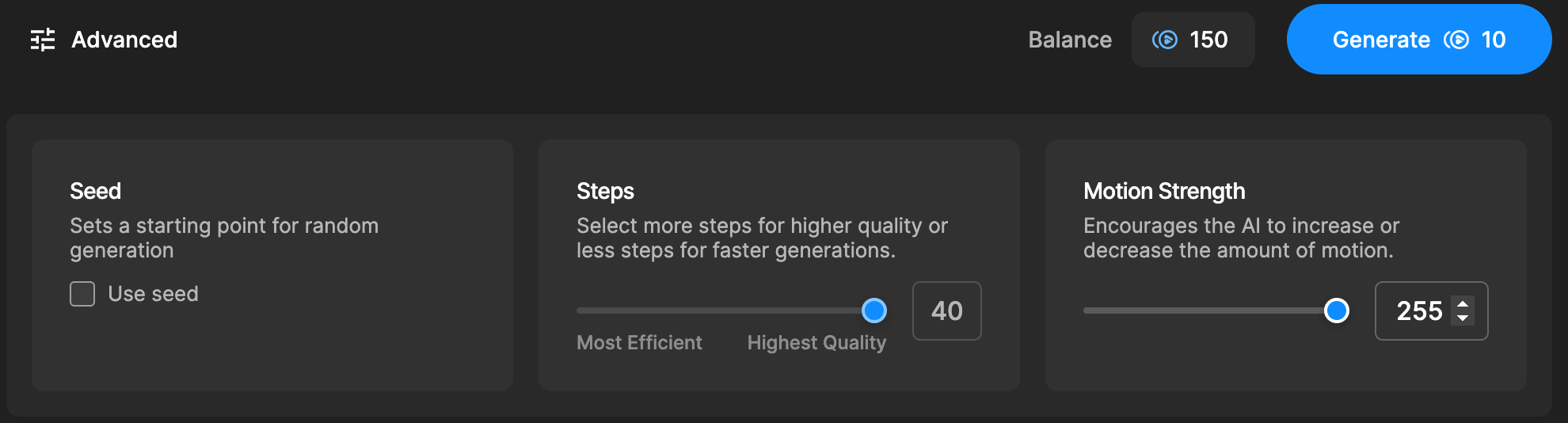

また、下部にはAdvanceという項目もあり、Seed/Steps/Motion Strengthを設定することができます。

Motion Strengthは、今の所『255』という数値がMAXなようです。

試しにMotion StrengthをMAXにして、生成した動画がこちらです。

先ほどまでの動画よりも、動きが大きく(早く)なっているのがわかるかと思います。

Stable Videoはまだまだ発展途上

使用してみた感想ですが「今のところはGen-2やPikaなどの動画生成AIに軍配が上がるかな」といった感じです。

というのも、画像から動画生成をする際に、追加でプロンプトを指定できないので、大きな動きを動画につけるのが難しいためです。

料金体系について

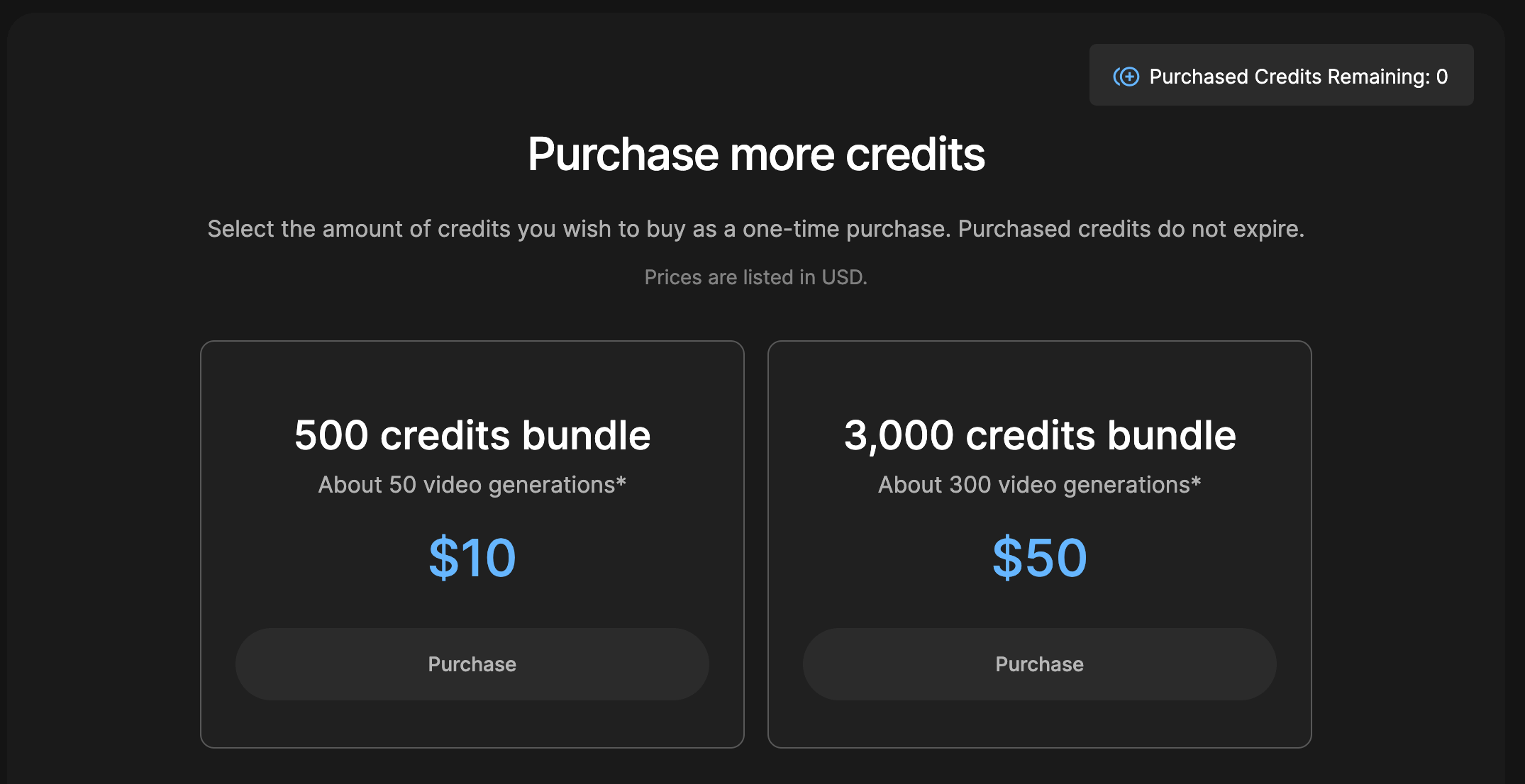

現状は会員登録を行うと、無料で150クレジット付与されます。

一つの動画を生成するのに大体10クレジットを使用するので、10個程度は動画生成可能です。

しかも、翌日になるとまた150クレジットに戻っているので、無料でも毎日それなりに楽しむことができます。

一応有料プランもあります。

500クレジットが$10、3000クレジットが$50という事ですが、今のところ課金の必要はないかなというのがかなり正直な意見です(個人的な意見です)

というのも、1日に150クレジット付与されるので、3日も経てば$10分の動画生成が可能だからです。

ひとまず無料で遊べる内に、動画生成までの流れを慣らしておくのが得策かと思います。